Quand un système s'emballe sans converger, il ne s'arrête pas — il mute.

Cet article est le deuxième d'une série consacrée aux fractures que produit la collision entre intelligence artificielle et conformité dans le secteur financier. Le premier, « IA et conformité : aux prises avec une transformation mutuelle », est disponible ici.

Le compliance officer et le régulateur vivent la même expérience : celle d'un monde qui mute plus vite que notre capacité à le cartographier. La sidération ne vient pas de l'ampleur de la tâche, mais de l'absence d'une carte.

RGPD, AI Act, DORA, NIS2, AMLA, ESG — chaque nouveau texte s'ajoute aux précédents sans les remplacer, et leurs interactions créent une complexité qui n'est plus linéaire mais combinatoire. Simultanément, on demande à la fonction conformité d'intégrer l'IA dans ses processus — mais cette IA est elle-même soumise à des exigences de conformité : il faut se conformer à des règles sur l'outil qui aide à se conformer aux règles. Le régulateur, de son côté, court après un objet en mouvement : l'AI Act a mis quatre ans à être adopté — pendant ce temps, le paysage technologique a radicalement changé. Et pour tenter de rattraper cet objet, il adopte lui-même l'IA, devenant à la fois régulateur et utilisateur de ce qu'il régule.

Chacun décrit les mêmes symptômes — accélération, empilement, perte de repères. Il faut alors tenter de décrire le système qui les produit.

Que l'IA transforme la conformité, c'est désormais un constat largement partagé — du FMI au FSB, des Cabinets de Conseil aux Autorités de Supervision. Que la conformité, en retour, alimente la demande d'IA, c'est tout aussi documenté. Mais ces deux observations circulent séparément. Personne ne les a assemblées en ce qu'elles sont : les deux faces d'une même boucle de renforcement réciproque.

Le mot « plus » recouvre des réalités très différentes — et ces différences déterminent des dynamiques distinctes.

Plus de conformité, cela peut signifier plus d'efficacité dans ce qu'on fait déjà, ou un périmètre élargi à de nouveaux domaines réglementaires, ou plus de finesse dans le grain du contrôle — de l'échantillonnage vers l'exhaustif —, ou encore une accélération du contrôle, du rétrospectif vers le temps réel. Ce ne sont pas les mêmes problèmes, ce ne sont pas les mêmes besoins.

Côté IA, les mêmes catégories fonctionnent mais la distinction la plus importante n'est pas quantitative. C'est le passage d'une IA qui assiste — l'humain décide, l'IA exécute ou recommande — à une IA qui agit — l'IA décide et exécute. L'humain supervise ou est informé. En bref, l'IA instrumentale renforce la conformité existante, l'IA agentique la subvertit, parce qu'elle commence à dissoudre la frontière entre l'action et le contrôle de l'action. On y reviendra.

Chaque dimension du « plus » côté conformité appelle un « plus » spécifique côté IA, et inversement. Plus de finesse du contrôle demande plus de puissance des modèles. Un plus large périmètre demande un usage de l'IA dans de nouveaux domaines voire de nouveaux modèles. Et plus de vitesse rend possible — puis finit par exiger — l'IA agentique, parce que le contrôle en temps réel ne peut plus être humain.

Mais il y a, parmi ces croisements, une singularité. Les dimensions extensives du "plus" — périmètre, domaines, volume — changent l'échelle. Les dimensions intensives — vitesse et finesse — changent le régime. Et ce changement de régime a une structure commune : le passage du discret au continu. La vitesse passe du contrôle périodique au flux permanent. La finesse passe de l'échantillonnage au contrôle exhaustif.

Une fois les « plus » explicités, on voit que la boucle de renforcement n'est pas un mécanisme unique — elle se décompose en deux dynamiques de nature différente.

La première opère à une échelle micro, au sein de la fonction conformité des organisations. Confrontée à la croissance de ses exigences, la conformité automatise : traitement des alertes LCB-FT, veille réglementaire, analyse de contrats, reporting prudentiel… Ces outils, une fois déployés, augmentent les capacités de contrôle. Ce qui était impossible par manque de ressources devient réalisable. Le périmètre attendu s'élargit — et avec lui, le besoin de plus d'IA. Les amendes de conformité ont atteint 4,6 milliards de dollars en 2024, les coûts de conformité 206 milliards dans les principaux marchés. La pression à l'adoption est mécanique.

La seconde opère à une échelle macro, au niveau de l'écosystème. L'IA envahit l'ensemble des activités économiques, ce qui crée un besoin de régulation — AI Act, DORA, initiatives du FSB, cadre du NIST. Cette nouvelle réglementation crée à son tour un besoin accru d'IA pour la traiter. Le FMI anticipait dès 2021 l'émergence d'« écosystèmes financiers en boucle fermée » où RegTech, SupTech et IA communiqueraient directement — tout en soulignant que ces avancées créaient de nouvelles préoccupations qui appellent… plus de régulation.

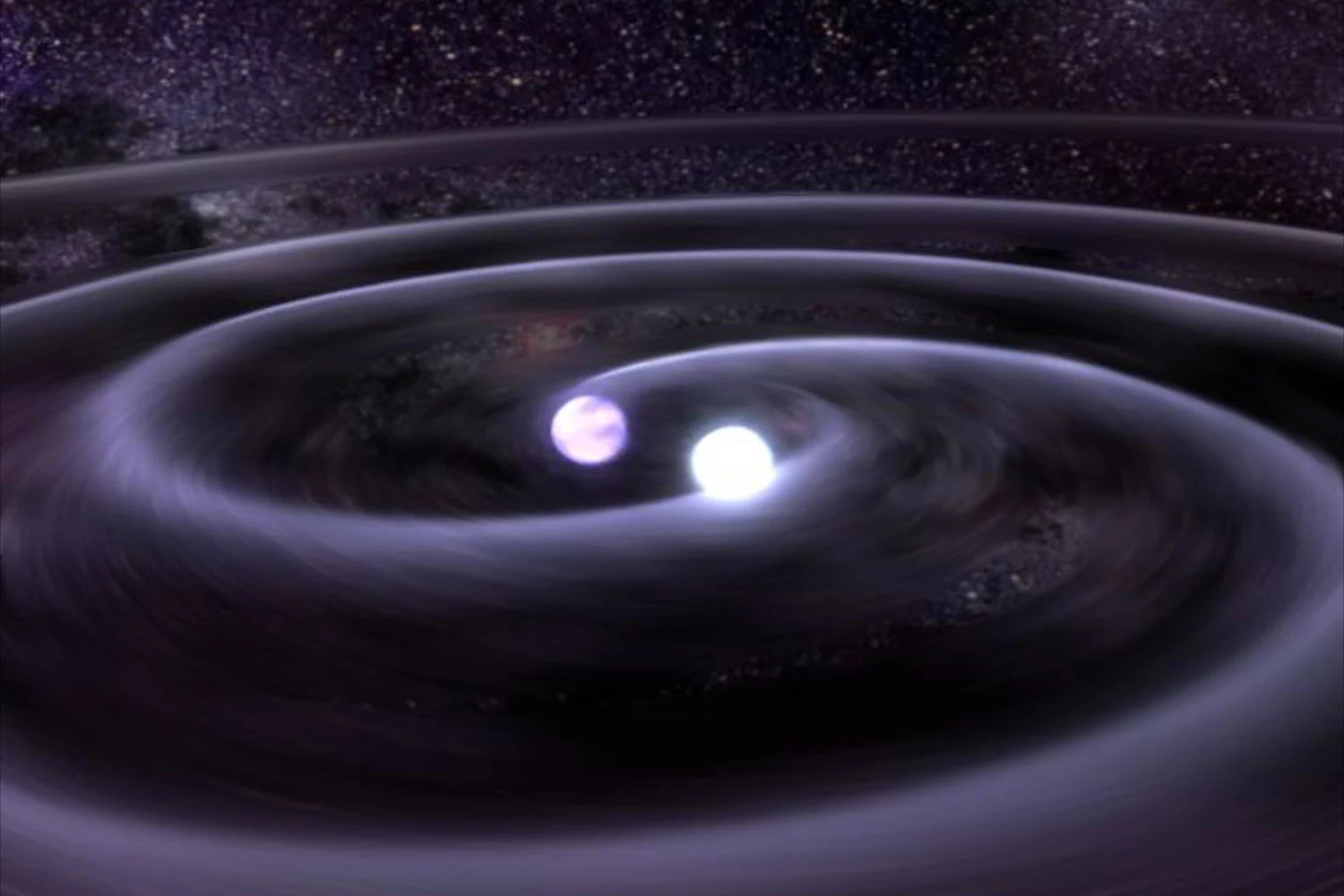

Ces deux boucles ne tournent pas indépendamment. Elles se couplent. L'adoption de l'IA par les organisations (boucle micro) alimente le besoin de régulation (boucle macro). La nouvelle réglementation (boucle macro) alimente le besoin d'IA dans les organisations (boucle micro).

L'emballement a son propre emballement.

On pourrait objecter que la dynamique n'est pas uniformément positive. Et c'est vrai : il existe des forces de sens contraire.

Plus d'IA peut signifier moins de conformité, quand les acteurs dominants pèsent sur les régulateurs pour freiner l'encadrement. L'administration américaine l'a illustré en 2025 avec une série de mesures explicitement dérégulatoires.

Plus de conformité peut signifier moins d'IA, quand la sur-régulation décourage l'innovation. C'est le scénario européen : l'AI Act, par sa complexité, pourrait pousser les développeurs vers des juridictions moins contraignantes. D’après le Centre for European Policy Studies (voir lien en fin d'article), le surcoût de conformité en partant de zéro pour un système IA à haut risque peut atteindre 17 %. De nombreuses start-ups européennes se sont déjà relocalisées. La régulation peut-elle tuer ce qu'elle prétend encadrer ? La question n'est pas rhétorique — mais le débat reste ouvert. Carnegie Endowment argue que les vrais freins à la compétitivité européenne sont structurels — fragmentation du marché, dépendance aux hyperscalers américains — et non réglementaires.

Et il y a un mécanisme plus subtil encore : les grands acteurs de l'IA peuvent avoir intérêt à une régulation forte, non par vertu, mais parce qu'elle élimine les concurrents plus petits. C'est la regulatory capture décrite par George Stigler, déjà vérifiée avec le RGPD. Plus de régulation concentre le marché — et les acteurs concentrés ont plus d'influence sur la régulation suivante.

Mais ces dynamiques d’amortissement sont de nature différente de la dynamique d'emballement. Les boucles de renforcement (micro et macro) sont structurelles : elles sont inscrites dans la logique même du système — si la capacité de contrôle augmente, l'attente de contrôle augmente ; si l'IA se déploie, le besoin de l'encadrer suit. Elle n'a besoin d'aucune décision pour s'activer. Les dynamiques d’amortissement sont conjoncturelles : elles dépendent d'une administration qui dérégule, d'un lobbying qui réussit, d'un rapport de force momentané. Elles n'ont pas de moteur — elles sont un frein. Et les freins s'usent.

Si la dynamique structurelle domine, la question est inévitable : où mène-t-elle ? Vers un équilibre ? Il faudrait que les deux termes puissent se stabiliser simultanément — or chaque palier de capacité de l'IA ouvre de nouveaux besoins de conformité, qui ouvrent de nouveaux besoins d'IA. La boucle n'a pas de point d'arrivée naturel.

Quand un système s'emballe sans converger, il ne s'arrête pas — il mute.

Comprendre la double boucle comme un système dynamique — et non comme un constat — change la donne pour ceux qui la vivent. Le compliance officer qui distingue la boucle micro de la boucle macro, qui saisit leur couplage, qui comprend pourquoi les dynamiques de renforcement sont structurelles et les dynamiques de freinage conjoncturelles, n'est plus dans la sidération. Il a une carte. La carte n'est pas le territoire — mais sans carte, on subit le territoire.

Et la carte révèle une singularité. Parmi tous les axes de couplage, la plupart changent l'échelle : plus de périmètre, plus de domaines, plus de puissance. La conformité fait la même chose plus largement, l'IA la même chose plus massivement. La séparation entre l'action et le contrôle est préservée.

Deux axes font autre chose :

Deux seuils, une même structure : le passage du discret au continu. La vitesse continue abolit l'écart temporel entre l'action et son contrôle. La finesse continue abolit la frontière entre ce qui est contrôlé et ce qui ne l'est pas. Ce sont les deux espaces — le temps et l'angle mort — sur lesquels repose tout le modèle actuel de la conformité.

C'est le moment où le « plus » devient « autre chose ».

C'est ce basculement — et ce qu'il fait au statut juridique du contrôle — qui fera l'objet des prochains articles de cette série.

Note : Les articles sont la partie visible d'une étude approfondie du couplage "IA - conformité" qu'il nous semble important d'affronter collectivement dans cette phase d'accélération décrite par lAEFR lors de l'événement du 9 avril.

- FMI — Aditya Narain, « AI and Regtech », 29 octobre 2021

https://www.imf.org/en/News/Articles/2021/10/29/sp102921-ai-and-regtech

- FSB — « The Financial Stability Implications of Artificial Intelligence », novembre 2024

https://www.fsb.org/uploads/P14112024.pdf

- Bagherifam, N. et al. — « Digital Regulatory Governance: The Role of RegTech and SupTech », MDPI Finances, novembre 2025 :

. https://www.mdpi.com/2227-7072/13/4/217

- FinTech Magazine — « How AI is Revolutionising RegTech and Compliance », novembre 2025

https://fintechmagazine.com/news/how-ai-is-revolutionising-regtech-and-compliance

- Executive Order 14179, « Removing Barriers to American Leadership in AI », janvier 2025

https://www.govinfo.gov/content/pkg/FR-2025-01-31/pdf/2025-02172.pdf

- White House — « Winning the Race: America's AI Action Plan », juillet 2025

https://www.whitehouse.gov/wp-content/uploads/2025/07/Americas-AI-Action-Plan.pdf

L'objection (+,−) — scénario européen :

- CEPS (Centre for European Policy Studies) — Clarifying the costs fir the EU’s AI Act

https://www.ceps.eu/clarifying-the-costs-for-the-eus-ai-act/

- Bloomberg Law — « EU AI Act's Burdensome Regulations Could Impair AI Innovation », février 2025

- Carnegie Endowment — « The EU's AI Power Play: Between Deregulation and Innovation », mai 2025